NVIDIA übernimmt GAA-Transistoren: Huang verspricht einen Leistungszuwachs von 20%

Während der GTC 2025-Konferenz in San Jose enthüllte NVIDIA-CEO Jensen Huang Details zur technologischen Strategie des Unternehmens, die Halbleiterinnovation mit der Entwicklung einer robusten KI-Infrastruktur kombiniert. Laut Huang wird der Übergang zu Gate-All-Around (GAA) Transistoren in den kommenden Feynman-Chips — die bis 2028 erwartet werden — die Leistung um bis zu 20% steigern. Das Unternehmen legt jedoch besonderen Wert auf architektonische und Softwarelösungen, anstatt nur darauf zu drängen, die neuesten Fertigungsprozesse zu übernehmen.

Huang stellte fest, dass die Ära revolutionärer Durchbrüche in der Lithographie zu Ende geht. Selbst der Übergang zu den vielversprechenden 2-nm-Knoten mit GAA-Transistoren, wie von TSMC geschätzt, wird voraussichtlich nur eine Verbesserung der Leistung um 10–15% bieten. Dennoch plant NVIDIA — traditionell vorsichtig mit „rohen“ Technologien — optimierte Versionen wie N2P oder A16 mit umgekehrter Stromversorgung zu verwenden. Huang glaubt, dass dieser Ansatz den behaupteten Gewinn von 20% durch die Reduzierung des Widerstands und die Stabilisierung des Stromverbrauchs erreichen wird.

Huang machte deutlich, dass NVIDIA sich nicht mehr als traditioneller Halbleiterhersteller sieht. Stattdessen baut das Unternehmen eine umfassende KI-Infrastruktur auf, die Algorithmen für Computer Vision, Robotik und sogar Chipdesign umfasst. Ein Beispiel für diese Strategie sind die kommenden Rubin-Plattformen (geplant für 2026) im 3-nm N3P-Prozess, die die Vera-GPU und eine CPU in einer einheitlichen Architektur für Rechenzentren integrieren werden. Doch, wie Huang betont, wird ihr volles Potenzial erst in Kombination mit proprietären Frameworks wie CUDA und Omniverse realisiert.

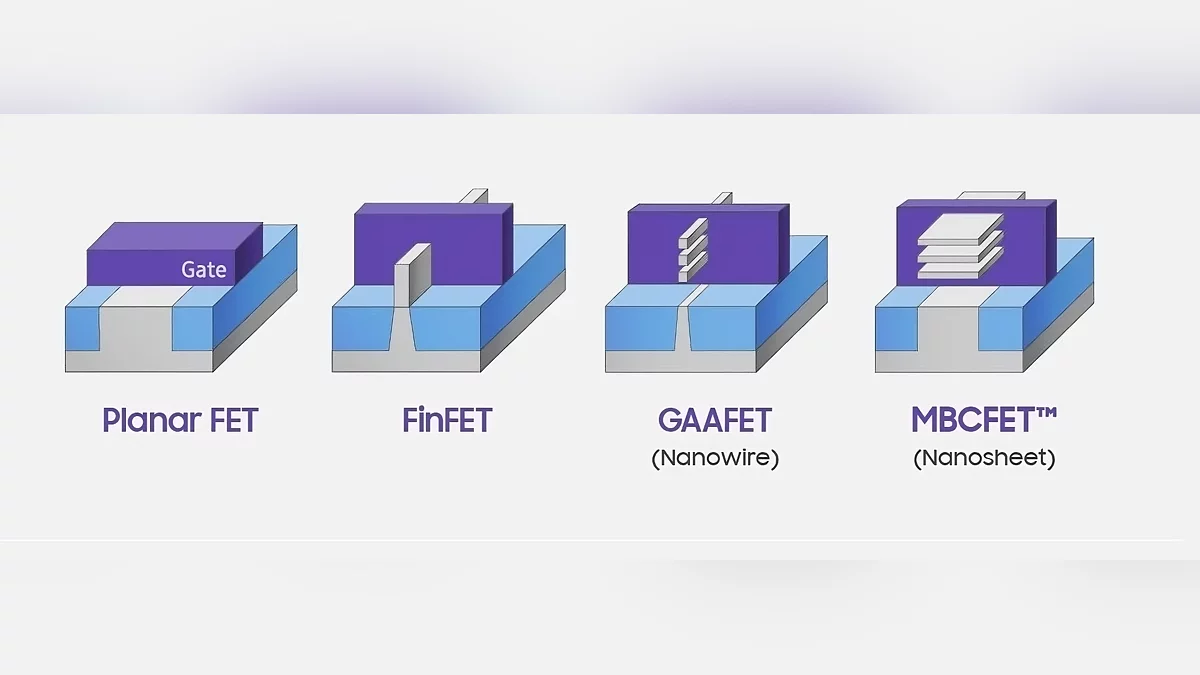

Das Interesse an GAA-Technologie ist gerechtfertigt, da diese Transistoren tatsächlich in der Lage sind, eine Leistungssteigerung zu liefern. Bei GAA-Transistoren umschließt das Gate den leitenden Kanal vollständig, minimiert Leckströme und verbessert die Kontrolle. Analysten weisen darauf hin, dass Huangs Aussagen einen breiteren Branchentrend widerspiegeln: den Fokus von der bloßen Erhöhung der Taktraten auf die Optimierung der Energieeffizienz und Skalierbarkeit zu verlagern. Mit der Expansion von KI-Clustern könnte selbst ein 20%-iger Leistungszuwachs auf Chip-Ebene potenziell die Leistung von Rechenzentren verdoppeln — vorausgesetzt, die Integration wird clever gehandhabt.

-

NVIDIA stellt die RTX PRO 6000-Serie Grafikkarten mit 96 GB Speicher vor

-

Gerücht: NVIDIA plant die Einführung von zwei Versionen der GeForce RTX 5060 Ti im April

-

NVIDIA verteidigt das Versagen der RTX 50 und gibt den Nutzern die Schuld

-

NVIDIA stellt PC mit 72-Kern-CPU und Blackwell-GPU vor

-

NVIDIA veröffentlicht ein Update für die NVIDIA App mit DLSS-Anpassung